Kan EU’s nye AI-lov balancere hensyn til innovation og sikkerhed?

EU’s lov om kunstig intelligens skal balancere hensyn til sikkerhed og til innovation og øget levestandard, men den risikobaserede model møder især kritik fra erhvervslivet og de tre store EU-lande.

Hovedkonklusioner

- Den nye lovgivning om kunstig intelligens (AI), som forhandles i EU-systemet disse uger, kritiseres af erhvervslivet for at have for mange forbud og for at lægge for stort ansvar over på de virksomheder, som udvikler systemerne. Både erhvervslivet og de tre store EU-lande (Tyskland, Frankrig, Italien) frygter, at forslaget vil hæmme udvikling og brug af kunstig intelligens.

- EU’s forslag til en lov om kunstig intelligens er risikobaseret. Kinesiske systemer til ”real-time” ansigtsgenkendelse forbydes. Systemer til CV-scanninger pakkes ind i særlig lovgivning. Desuden kræves forhåndsgodkendelse af en række systemer for at respektere forbruger- og miljølove.

- Kommissionsformandens forslag om en EU AI-myndighed til obligatoriske test og certificering af AI-systemer inden anvendelse i EU kan måske være vejen frem for at balancere hensyn til sikkerhed og konkurrenceevne - sammen med færre forbud i lovgivningen og større støtte til brug og udvikling af kunstig intelligens i EU.

- Kunstig intelligens kan bidrage til at løse nogle af klodens sygdomsproblemer og bidrage til klimaomstillingen samt øge den globale produktivitet og levestandard. Men kunstig intelligens kan også bruges til at påvirke demokratiske valg negativt via udbredelse af falsk information såsom ”deepfakes”, til negativ social diskrimination i ansættelser og til overvågning af befolkninger via ansigtsgenkendelse. Nogle ser også muligheden for, at kunstig intelligens kan føre til katastrofer sidestillet med pandemier og atomkrig.

Mandag den 30. oktober 2023 underskrev USA’s præsident, Joe Biden, en præsidentiel bekendtgørelse om kunstig intelligens (AI). Ved hans side stod vicepræsident, Kamala Harris, der gjorde det klart, at ”… hvad angår kunstig intelligens, så er USA førende på verdensplan. Amerikanske virksomheder er ledende, hvad angår innovation af AI. USA kan som intet andet land i verden skabe global handling og enighed på området”.[1]

Udtalelsen faldt to dage før Harris’ deltagelse i en international konference i London om sikkerhed og kunstig intelligens. New York Times rapporterede fra konferencen under overskriften ”Globale ledere advarer om, at kunstig intelligens kan få katastrofale følger”.[2] Konferencen havde deltagelse af ledende politikere og erhvervsfolk fra 28 lande og internationale institutioner inklusive USA, Kina, EU og UK. Lederne enedes om en fælles erklæring om behovet for en evaluering og overvågning af udvikling og brug af kunstig intelligens.[3]

Også EU arbejder i Bruxelles febrilsk på at afslutte det lovgivende arbejde i Europa-Parlamentet og Rådet med det, som skal være verdens første omfattende lov om kunstig intelligens.[4] Med Præsident Bidens bekendtgørelse udestår spørgsmålet om, hvem der kommer til at sætte de internationale standarder for udvikling og anvendelse af kunstig intelligens.

USA har et forspring i og med, at amerikanske virksomheder er førende på udviklingen af kunstig intelligens som anført af vicepræsident Kamala Harris, men der er i stigende omfang fokus på frygten for, hvilke ulykker kunstig intelligens kan medføre, og her er EU-lovgiverne i front med hensyn til at indføre et forsigtighedsprincip.

Frygten for, hvad kunstig intelligens kan udvikle sig til, er blevet understreget i en udtalelse fra 360 forskere og erhvervsledere inden for området. De advarer mod, at teknologien kan løbe løbsk og føre til katastrofer.[5]

Dette brief vil se på risici og muligheder forbundet med udvikling og brug af kunstig intelligens, og hvordan forskellige tilgange til regulering forsøger at håndtere muligheder og risici. Også for kunstig intelligens ligesom for det digitale område som helhed kan spørgsmålet rejses, om frygten for, hvad fremtiden vil bringe, kan reducere mulighederne for at udnytte den nye teknologis fulde potentiale.[6] Det kan være et problem for et EU, som i stigende omfang er udfordret på sin konkurrenceevne.[7]

Kunstig intelligens kan løse problemer som sygdom og klimaforandringer

I november 2022 kom OpenAI’s sprogmodel chatbotten ChatGPT på markedet. Den åbnede den brede offentligheds øjne for, hvordan computere via læringsprocesser og stor computerkraft kan løse en række opgaver, som hidtil har været vanskelige for menneskeheden at løse. Teknologien kan medvirke til at løse sundhedsproblemer og bekæmpe klimaforandringer ved at lette fremstillingen af enzymer og dermed åbne for bedre sygdomsbekæmpelse, nedbrydning af plast i naturen og verdenshavene samt udtrækning af CO2 i atmosfæren.[8]

Markedet for udvikling af avanceret kunstig intelligens ventes at stige fra ca. 10,5 mia. USD i 2022 til over 208 mia. USD i 2032. Nordamerika – og især USA – er dominerende, mens Sydøstasien vil udvise størst vækstrate.[9] Konsulentfirmaet McKinsey skønner, at der vil blive muligheder for teknisk automatisering inden for alle professioner via brug af kunstig intelligens med størst effekt for ledende funktioner og professioner med længerevarende uddannelser.[10]

Herhjemme kalder professor i digitalisering på CBS, Jan Damsgaard, i en artikel i DJØF-bladet kunstig intelligens for en større ”game-changer” end internettet. Kunstig intelligens udfordrer iflg. Jan Damsgaard allerede nu erhvervslivets ledere, som hurtigst muligt må i gang med at udvikle en strategi for virksomhedernes brug af kunstig intelligens.[11]

Frygten for kunstig intelligens stiger

350 forskere og erhvervsfolk med tilknytning til udvikling og brug af kunstig intelligens udtrykker i et åbent brev frygt for, at teknologien kan føre til katastrofer sidestillet med pandemier og brug af atomvåben.[12] Samtidigt har globale ledere og erhvervsfolk fra 28 lande og internationale institutioner brugt det meste af deres møde på Bletchley Park i England den 2. og 3. november 2023 til at tale om, hvordan man imødegår risici og katastrofer ved brug af en ny teknologi som kunstig intelligens.[13] Det giver naturligt udbredt genlyd i medier og blandt folkevalgte jf. figur 1.

Også indenfor specifikke områder kommer der advarsler om negative konsekvenser ved brug af kunstig intelligens. For finanssektoren har formanden for det amerikanske børstilsyn, SEC, Gary Gensler, udtrykt sin frygt for, at anvendelse af kunstig Intelligens i finanssektoren kan føre til den næste finanskrise, hvis sektoren som ventet vil gøre brug af et begrænset sæt modeller, som i tilfælde af uro kan udløse en selvopfyldende investortilbagetrækning fra givne markeder eller nødlidende banker.[14]

Stigende bekymring i befolkningerne over for kunstig intelligens

Uroen blandt fagfolk og erhvervslivets ledere afspejler sig også i en stigende uro i befolkningen i USA, hvor antallet af bekymrede amerikanere i en undersøgelse fra PEW Instituttet er steget fra 37 pct. til 52 pct. fra 2021 til 2023.[15]

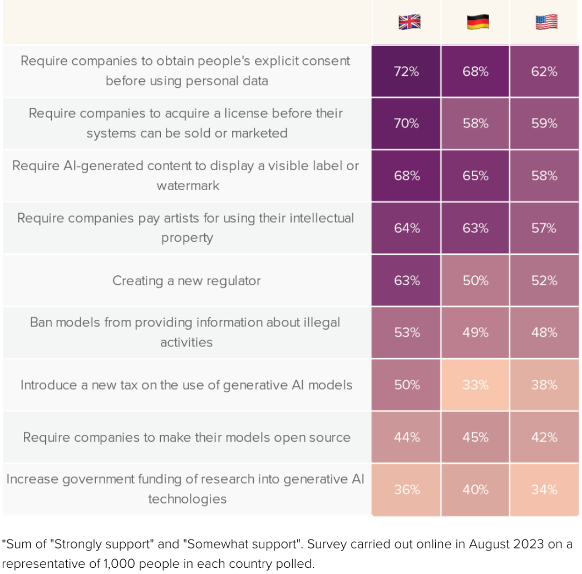

I en undersøgelse fra Global Counsel for mediet Politico med 1000 adspurgte i hvert af landene UK, Tyskland og USA er der et flertal for en skrappere regulering af udviklingen og brugen af kunstig intelligens, jf. figur 1. Et flertal af befolkningerne i de tre lande ser et behov for regulering af kunstig intelligens i form af brugen af persondata, i form af et licens/godkendelsessystem af kunstig intelligens-modeller, i form af en klar markering ved anvendelse af kunstig intelligens og ved en sikring af betaling af copyrights.[16]

Figur 1: Befolkningerne i UK, Tyskland og USA ønsker særlig regulering af kunstig intelligens

Kilde: Global Counsel

Kommissionens forslag til regulering af kunstig intelligens er baseret på en risikovurdering

Den 21. april 2021 fremsatte Kommissionen et forslag til regulering af kunstig intelligens, som udgør det første forslag til regulering af kunstig intelligens på verdensplan. Reguleringen skal sørge for, at AI-systemer, der sælges og anvendes i EU, er sikre og overholder eksisterende lovgivning om grundlæggende rettigheder. Kunstig intelligens anses som afgørende for fremtidens industri. EU ønsker derfor at være i front, hvad angår brugen af kunstig intelligens i fremtidens europæiske økonomi.

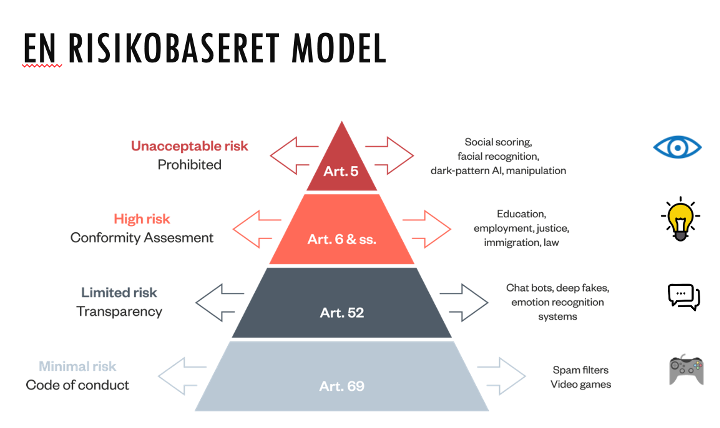

Kommissionens forslag er baseret på en risikovurdering af brugen af AI-systemerne, jf. figur 2. Anvendelser med uacceptabel høj risiko som kinesiske systemer til ansigtsgenkendelse forbydes. Anvendelser med høj risiko som CV-scanninger bliver pakket ind i særlig lovgivning. Brug af kunstig intelligens-systemer i EU vil også i visse tilfælde kræve forhåndsgodkendelse for at respektere EU’s miljø- og forbrugerbeskyttelse.[17]Risikoprincippet i forslaget roses bl.a. fra IMF.[18]

Figur 2. EU-Kommissionens forslag til AI-Lov er risiko baseret

Kilde: Professor Rebecca Adler Olsen, Københavns Universitet. Præsentation ved Tænketankens konference hos IDA, 17.november 2023

Kommissionens forslag kritiseres for at have for mange undtagelser og huller, hvilket kan indebære for høj risiko og mindske tilliden til brug af kunstig intelligens. Forslaget kritiseres også for at være ufleksibelt og for lempeligt i og med, at en fremtidig anvendelse af kunstig intelligens på en måde eller i en sektor, som ikke er forudset i loven, vil være lovlig, fordi den ikke er nævnt i anneks 1 til lovforslaget. Endeligt kritiseres forslaget også for at indebære for høje omkostninger for virksomheder, som vil udvikle og anvende kunstig intelligens. Nogle af disse beregninger betegnes dog som misvisende ifølge tænketanken CEPS, som henviser til Kommissionens egne beregninger, hvor omkostningerne er relativt beskedne.[19]

Rådet og Europa-Parlamentet har flere krav til AI-systemer

Både Ministerrådet[20] og Europa-Parlamentet[21] lægger i deres forslag til EU’s AI-lov stor vægt på, at brugen af kunstig intelligens i EU skal respektere fundamentale rettigheder som retten til private data, ikke-diskrimination på baggrund af etnicitet, køn og seksuelle præferencer. Derudover fokuserer begge parter i høj grad på risici ved anvendelse af såkaldte”foundation-modeller” som ChatGPT, der blev lanceret af virksomheden OpenAIR i november 2022. Denne type model for kunstig intelligens vurderes som værende blandt højrisiko-modeller.[22]

Forslaget fra især Europa-Parlamentet indeholder flere forbud, især vedrørende brug af kunstig intelligens til genkendelse af personer i de offentlige rum og skærpede rettigheder for forbrugere, borgere og virksomheder angående retten til egne data. Det tvinger bl.a. udviklere af kunstig intelligens til at offentliggøre det datagrundlag, som deres modeller er bygget op omkring.[23]

Forhandlingerne mellem Råd, Europa-Parlament og Kommission om den endelige udformning af AI-loven sigter mod en afslutning inden udgangen af 2023 og er besværlige bl.a. vedrørende adgang for nationale sikkerhedstjenester til at anvende AI til persongenkendelser i tilfælde af mistanke om terror og andre alvorlige forbrydelser.[24] På en konference om kunstig intelligens og EU’s digitale suverænitet erklærede Christel Schaldemose, socialdemokratisk medlem af Europa-Parlamentet, sig forsigtigt optimistisk med hensyn til at nå til enighed om EU’s AI-lov den 6.december 2023.[25]

Hård kritik fra europæisk erhvervsliv af forslagene til en EU AI-lov

I et åbent brev til Kommissionen, Ministerrådet og Europa-Parlamentet fra slut juni 2023 kritiserer over 150 europæiske topvirksomhedsledere forslagene til regulering af kunstig intelligens for at forværre Europas konkurrenceevne og teknologiske suverænitet uden at tackle de udfordringer, som produktion og brug af kunstig intelligens medfører.[26]

Erhvervslederne anerkender behovet for at teste avancerede systemer for kunstig intelligens for at sikre sikkerheden, før de anvendes. Ligeledes anerkendes behovet for et princip om forsigtighed ved udarbejdelse af avancerede modeller og for standardiseret certificering. Men EU-lovgivning bør begrænse sig til at fastsatte principperne for den risikobaserede tilgang og overlade detaljer til eksperter på EU-niveau. Brevet anbefaler også at søge en transatlantisk enighed om principperne for regulering af kunstig intelligens.[27]

EU-forslagene introducerer en kompliceret ansvarsplacering iflg. advokater

Via et direktiv om ansvar i forbindelse med brug af kunstig intelligens ønsker EU-institutionerne at gøre det lettere for brugere af kunstig intelligens at placere et eventuelt ansvar i tilfælde af fejl eller skader. En juridisk gennemgang af direktivforslaget fremhæver, at der som udgangspunkt etableres en antagelse om årsag relateret til brug af avancerede modeller for kunstig intelligens, hvis den forurettede kan klargøre skaden og redegøre for, at vedkommende inden anskaffelse eller brug har anmodet om oplysninger om brugen af systemet hos producenten. For at gøre det nemmere for borgere og SMV’ere at rejse retssager åbner direktivet for såkaldte ”class action”-retssager i forbindelse med produktion, salg og brug af kunstig intelligens.[28]

Det vil gøre udviklerne af systemerne ansvarlige for overtrædelser af EU’s lovgivning, selvom selve overtrædelseshandlingen udføres af et andet firma, som har erhvervet rettigheder til brugen af den kunstige intelligens. Det har medført stærke protester fra industrien – techgiganter såvel som bilindustrien jf. ovennævnte brev fra de mere end 150 erhvervsledere.[29]

Googles chef for globale anliggender, Kent Walker, har i den anledning iflg. Financial Times sagt, at det svarer til, at en producent af skrivemaskiner gøres ansvarlig for injurier skrevet på maskinen. Dog har de fleste juridiske systemer et mere balanceret ansvar, hvor ansvaret dækker forudsigelige hændelser.[30]

De 3 store lande ønsker en mindre generel regulering baseret på anvendelsen af AI-modeller

Kommissionens tjekkiske viceformand, Vera Jourova, har også advaret mod at blive paranoid omkring risici ved brug af avanceret kunstig intelligens. Hun tilskynder til, at der tages hensyn til forudsigelige og i øjeblikket kendte risici samt at justere listen over højrisikotilfælde senere i tråd med den teknologiske udvikling. Fra Europa-Parlamentets side anfører italieneren Brandei Benifei (S&D), som er en af de to hovedforhandlere fra Europa-Parlamentet på forslaget, at Parlamentet må forsvare de europæiske rettigheder. Tilgangen baseret på risici er ikke tilstrækkelig til at sikre en klar lovgivning med juridisk klare rettigheder for borgerne, virksomhederne og offentlige institutioner.[31]

Den 19. november har de tre store EU-lande, Frankrig, Italien og Tyskland, præsenteret et non-paper i forhandlingsprocessen, som kan lamme de igangværende forhandlinger om EU’s AI-lov. Papiret går imod en generel risikoregulering af foundation-modeller som ChatGPT. En sådan regulering vil ifølge de tre lande stride imod princippet om en teknologineutral regulering, som kan sikre en balance mellem innovation og sikkerhed. I stedet ønsker de tre lande en tvungen selvregulering af industrien inkl. test af og transparens omkring de generelle modeller.[32]

Kan kunstig intelligens løfte produktiviteten i den globale økonomi?

I 1987 udtalte den amerikanske Nobel-pristager i økonomi, Robert Solow, at man kan se computerteknologien overalt, undtagen i produktivitetstallene. Det såkaldte produktivitetsparadoks.[33] Spørgsmålet er, om kunstig intelligens inklusiv voksende computerkraft kan blive den game-changer, som flere ser, jf. professor Jan Damsgaard.

Der er allerede flere skøn for en mulig produktivitetsgevinst som følge af kunstig intelligens. Finansbanken Goldman Sachs har beregnet en mulig vækst i den globale økonomi over en 10-årig periode på 7 billioner USD, svarende til et produktivitetsløft på 1,5 pct. point.[34] Konsulentfirmaet McKinsey skønner, at brug af kunstig intelligens kan løfte det globale BNP med 2,6 til 4,4 billioner USD og løfte produktiviteten med 0,1 til 0,6 pct. årligt til 2040.[35]

Den amerikanske nobelpristager i økonomi, Michael Spence, ser mulighed for, at kunstig intelligens kan skabe produktivitetsstigninger, som kan kompensere for aldring af befolkninger og aftagende stigning i udbud af industrielle varer eller input til industriel produktion i de gamle, rige industrilande fra ”emerging economies”, ikke mindst fra Kina, ved at anvende kunstig intelligens som ”digitale assistenter”[36]

Herhjemme taler professor Jan Damsgaard om muligheden for at kompensere for manglende arbejdskraft, særligt i sundhedssektoren, men også for at bruge den øgede produktivitet til at sætte arbejdstiden ned.[37]

Kan EU anvende kunstig intelligens til at rette op på sin skrantende konkurrenceevne?

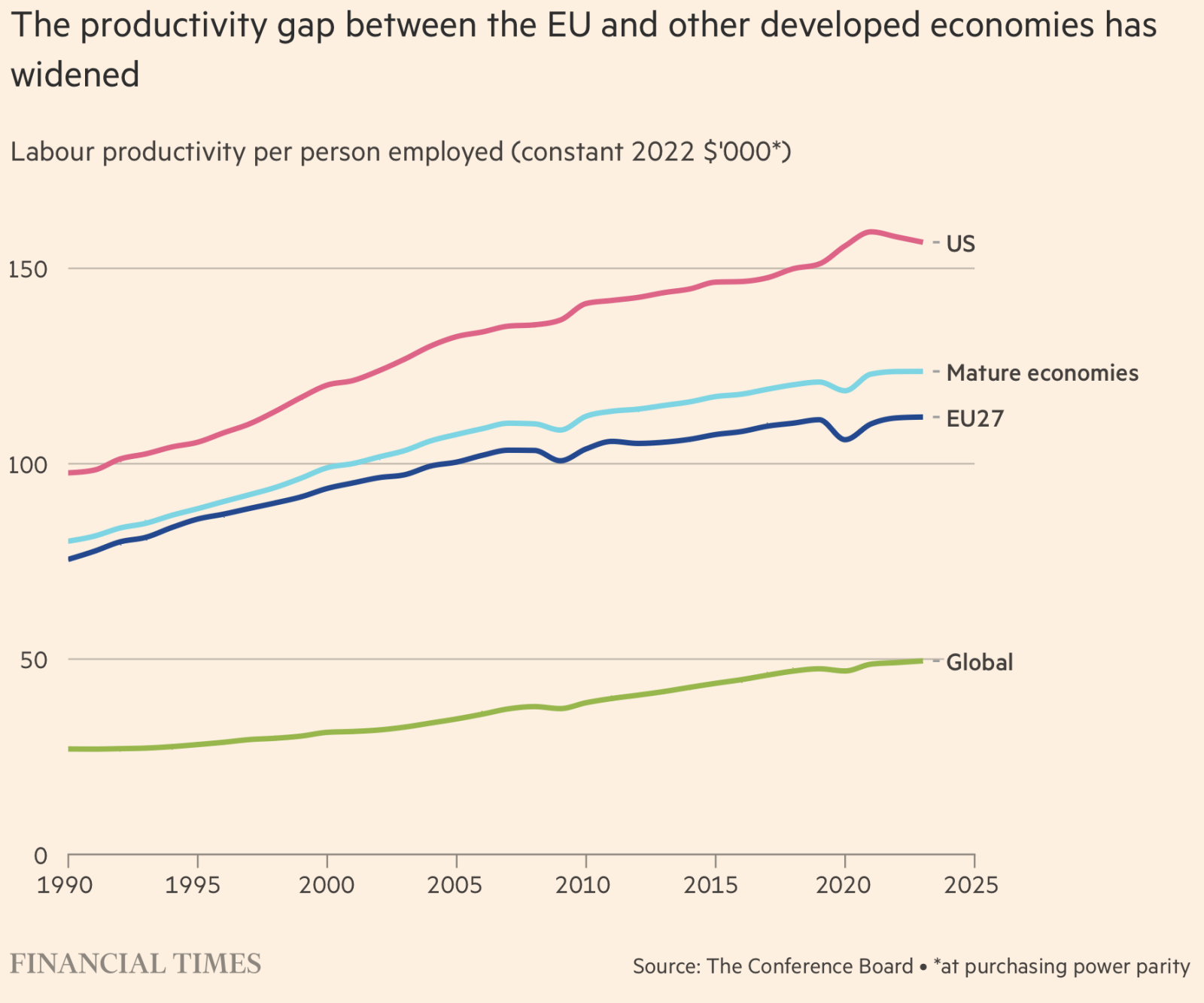

De stigende energipriser som følge af Ruslands krig i Ukraine og andre regioners, ikke mindst USA’s økonomiske støtte i forbindelse med Covid-pandemien og ændringen i de globale forsyningskæder, betyder en forværring af EU’s fremtidige konkurrencekraft over for USA og også Sydøstasien og Japan, jf. figur 3.[38]

Figur 3. EU konkurrencekraft halter efter USA og andre modne økonomier

Udvikling og brug af kunstig intelligens ses som en mulighed for de rige, modne økonomier for at kompensere for deres mangel på arbejdskraft og aldrende befolkning[39]. Men det fordrer, at der både sker en hurtig udvikling og udbredelse af brugen af kunstig intelligens.

I erklæringen fra det britiske topmøde den 1. og 2. november 2023 om sikkerhed ved brug og udvikling af kunstig intelligens anerkender de deltagende repræsentanter fra landene og EU betydningen af en pro-innovativ tilgang til proportionel styring og regulering, som maksimerer goderne og tager hensyn til risici ved kunstig intelligens.[40]

USA har et klart forspring ift. EU med hensyn til udvikling af AI-systemer

Som anført ovenfor er der sået tvivl om, hvorvidt EU’s forslag til regulering af kunstig intelligens vil være pro-innovativ og proportionel. Samtidig er EU’s udgangspunkt ikke lovende. EU er klart bagud mht. udvikling og brug af kunstig intelligens i forhold til USA og de asiatiske lande.[41]

Det er i høj grad de amerikanske techgiganter, som udvikler avancerede systemer til brug af kunstig intelligens. USA har også i forhold til EU en klar føring med hensyn til igangsætning og opskalering af nye innovative virksomheder generelt og fsva. udvikling af kunstig intelligens.[42] USA’ massive føring på området fremgår af figur 4, som viser de private investeringer i kunstig intelligens fra 2013-22 fra Artificial Intelligence Index Report 2023 fra Stanford University.[43]

Figur 4. USA er klart førende hvad angår investeringer i kunstig intelligens

Kilde: Artificial Intelligence Report, 2023, Stanford University

I forbindelse med fremsættelse af forslaget om regulering af kunstig intelligens peger Kommissionen på betydningen af opbygningen af uddannelser til IT-ingeniører og software-programmører samt støtte til forskning og udvikling af kunstig intelligens. I den forbindelse har Kommissionen afsat 1 mia. euro årligt inden for forskningsprogrammet Horizon Europe og Digital Europe. Kommissionen regner med, at det kan føre til investeringer i størrelsesordenen 20 mia. euro om året inklusiv private og nationale bidrag.[44]

Herudover nævner Kommissionen at Genopretningsfonden stiller omkring 134 mia. euro til rådighed for medlemslandene på det digitale område frem til 2026.[45]Her skal dog nævnes, at det tager tid at få disse penge brugt,[46] og at de fleste af pengene til det digitale område vil blive brugt på andre områder end udvikling og udbredelse af kunstig intelligens.

Vil den amerikanske tilgang til regulering af kunstig intelligens blive førende?

Biden regeringens tilgang til regulering af kunstig intelligens, der af vicepræsident Kamala Harris betegnes som førende, tvinger den amerikanske administration til at udarbejde retningslinjer for kunstig intelligens baseret på en række principper om; test og certificering af systemernes sikkerhed og transparens, respekt for rettigheder til personlige data, ikke-diskrimination, forsvars- og sikkerhedshensyn, respekt for copyright og patentrettigheder. Retningslinjerne skal også sikre udbredelse af kunstig intelligens via uddannelse og forskning/innovation samt via brug af kunstig intelligens i det offentlige.[47]

De offentlige myndigheder skal samarbejde med akademia, eksperter og erhvervslivet samt andre repræsentanter fra det civile samfund, herunder fagforeninger. Retningslinjerne skal som udgangspunkt være klar om 9 måneder,[48] altså før præsidentvalget i USA næste år. Skulle Trump vinde valget, så vil hele processen formentligt blive stoppet, indtil en ny administration finder sin egen holdning til spørgsmålet om udvikling og brug af kunstig intelligens.

Om amerikanerne kommer til at sætte den globale standard for regulering af kunstig intelligens kan derfor ikke siges med sikkerhed. Den amerikanske tilgang vil tage hensyn til respekt for fundamentale rettigheder, til copyright-og patentrettigheder og til forsvars-og sikkerhedshensyn. Præcis hvordan ved vi ikke endnu. Desuden vil amerikanerne etablere test og certificering af AI-systemer- og modeller for at skabe sikkerhed og transparens ved udvikling og brug af kunstig intelligens.[49]

Den amerikanske tilgang åbner mulighed for mere evidensbaserede retningslinjer, som samtidig i visse situationer kan være mere præcise, da de er sektor- og område-specifikke udstedt af de pågældende myndigheder. Ligeledes forbyder de ikke udviklingen af specifikke modeller og systemer, og de udarbejdes i høj grad i samarbejde med stakeholdere (fagforeninger, NGO’er og akademia) samt industrien.

USA, UK og EU er enige om at oprette særlige AI-myndigheder

Den 1. og 2. november annoncerede USA, UK og EU, at de vil etablere hver sin AI-myndighed, som både kan teste og certificere avancerede AI-modeller og systemer i samarbejde med private virksomheder samt universiteter og forskningsinstitutter. Myndighederne skal også overvåge overholdelse af retningslinjer både internationalt såvel som på de respektive områder, og de skal også deltage i udviklingen af avancerede AI-modeller.[50]

Sådanne myndigheder kan være begyndelsen til en nødvendig klargørelse af ansvar mellem myndigheder og private virksomheder på AI-området samt give et løft til et samarbejde mellem myndigheder og private virksomheder til gavn for begge parter og til gavn for offentlighedens tillid til brug af avanceret kunstig intelligens.

Kan en særlig AI-myndighed medvirke til at gøre AI til en game-changer for EU?

Etablering af en EU AI-myndighed blev annonceret af Kommissionsformand Ursula von der Leyen den 2. november 2023 på konferencen i Bletchley Park i Storbritannien.[51] Om Kommissionsformanden har sikret sig opbakning til at oprette den pågældende myndighed, herunder de nødvendige budgetmæssige midler i det mindste – private virksomheders bidrag via betaling for myndighedens deltagelse i test m.m. kan ikke være tilstrækkelig – henstår i det uvisse. Ligesom at der også udestår spørgsmål om myndighedens forhold til Kommission, Europa-Parlament og EU-landene. Derfor er myndighedens oprettelse ikke givet på forhånd.

Den kunne dog være med til at gøre det mindre nødvendigt at skære alt ud i detaljer i en lovgivning på et tidspunkt, hvor muligheder og risici endnu ikke er klare. Samtidigt vil myndigheden ved deltagelse i test og certificering, herunder standardisering, både få stor indsigt i avancerede kunstig intelligens, som kan bruges, hvis det bliver nødvendigt at skærpe lovgivningen på et senere tidspunkt, samtidig med at test m.m. kan være med til at sikre mere transparens og sikkerhed omkring AI-modeller, uden at forretningsmodeller behøver at offentliggøres. Papiret fra de tre store EU-lande lægger også vægt på at bruge AI-myndigheden til at teste og certificere ”foundation—modeller”.[52]

Det skal også understreges, at intet testsystem og ingen lovgivning kan sikre sig 100 pct. mod misbrug af kunstig intelligens. Derfor er der også kommet en række forslag fra konsulentfirmaer, revisorer og akademia, som peger på behovet for klare virksomhedsstrategier og for en skærpet virksomhedskontrol på AI-området.[53]

Regulering og testsystemer må suppleres med støtte fra EU og de enkelte EU-lande til uddannelse af IT-ingenører og til udbredelse af en generel forståelse i befolkningerne for muligheder og risici forbundet med brug af kunstig intelligens. EU’s Genopretningsfond bør kunne bruges i højere grad, end den ser ud til at blive ifølge de nuværende nationale genopretningsplaner. I den forbindelse kan energiomstillingen væk fra russisk energi via programmet RepowerEU være en model, så landene opfordres til at ændre deres genopretningsplaner og i højere grad prioritere støtte til udvikling og opskalering af EU-start-ups inden for kunstig intelligens.

Tænketanken CEPS har kortlagt og peget på behovet for støtte til videreudvikling af et netværk bestående af EU-start-ups, EU-forskningsinstitutter og større industrivirksomheder.[54]

[1]https://ep.ft.com/permalink/emails/eyJlbWFpbCI6ImE5MDNmZGI4YjNkM2NlNGFkYmJhYjNiNGE0YzE2ZGYyYzNjMzJiOWFmZjYyM2ZlOSIsInRyYW5zYWN0aW9uSWQiOiI1NTU3NDU2MC1iMWRiLTRmZjgtODY4OS0yZWFmNTk3ZjJmYTgifQ%3D%3D

[3] https://www.gov.uk/government/publications/ai-safety-summit-2023-the-bletchley-declaration/the-bletchley-declaration-by-countries-attending-the-ai-safety-summit-1-2-november-2023

[4]https://ep.ft.com/permalink/emails/eyJlbWFpbCI6ImE5MDNmZGI4YjNkM2NlNGFkYmJhYjNiNGE0YzE2ZGYyYzNjMzJiOWFmZjYyM2ZlOSIsInRyYW5zYWN0aW9uSWQiOiJjYTc5YWZiMS03YjExLTQ5YjQtODZiYS04NDQ5NThlMDgwZTkifQ%3D%3D og https://thinkeuropa.dk/notat/2023-01-eus-digitale-suveraenitet-global-leder-eller-overregulering

[6] https://thinkeuropa.dk/notat/2023-01-eus-digitale-suveraenitet-global-leder-eller-overregulering og https://www.zetland.dk/historie/seQAkKZ7-mOLVGnYD-8d743

[7] https://www.ft.com/content/124b4cdb-deb9-49a0-b28d-d97838606661?desktop=true&segmentId=7c8f09b9-9b61-4fbb-9430-9208a9e233c8#myft:notification:daily-email:content

[10] https://www.ft.com/content/647fdf88-d757-45e4-a640-9654673b7ece?segmentId=114a04fe-353d-37db-f705-204c9a0a157b

[11] https://services.djoef.dk/r-aa-dgivning/netv-ae-rkogkarriere/ledelse/artikler/2023/professor-ledere-skal-rykke-p-aa--ai-nu.aspx?utm_source=SilverpopMailing&utm_medium=email&utm_campaign=MN_2023_Uge39%20(1)&utm_content=&spMailingID=27302262&spUserID=OTM0OTQ5OTk3NTkS1&spJobID=2312000372&spReportId=MjMxMjAwMDM3MgS2

[13] https://www.gov.uk/government/publications/ai-safety-summit-2023-the-bletchley-declaration/the-bletchley-declaration-by-countries-attending-the-ai-safety-summit-1-2-november-2023

[14] https://finans.dk/privatokonomi/ECE16564683/formand-for-usas-boerstilsyn-advarer-ai-risikerer-at-udloese-den-naeste-finanskrise/

[15] https://www.pewresearch.org/short-reads/2023/08/28/growing-public-concern-about-the-role-of-artificial-intelligence-in-daily-life/

[17] https://digital-strategy.ec.europa.eu/en/policies/european-approach-artificial-intelligence og AI-Presentation-CEPS-Webinar-L.-Sioli-23.4.21. PDF (www.ceps.eu) taget fra https://artificialintelligenceact.eu/the-act/

[18] https://www.washingtonpost.com/washington-post-live/2023/10/26/transcript-futurist-summit-new-artificial-hand/?utm_medium=email&utm_source=govdelivery

[19] https://artificialintelligenceact.eu/analyses/ og https://www.ceps.eu/clarifying-the-costs-for-the-eus-ai-act/

[20] https://www.consilium.europa.eu/da/press/press-releases/2022/12/06/artificial-intelligence-act-council-calls-for-promoting-safe-ai-that-respects-fundamental-rights/

[21] https://www.europarl.europa.eu/news/en/press-room/20230609IPR96212/meps-ready-to-negotiate-first-ever-rules-for-safe-and-transparent-ai

[22] Ibid.

[23] Ibid.

[24] https://ep.ft.com/permalink/emails/eyJlbWFpbCI6ImE5MDNmZGI4YjNkM2NlNGFkYmJhYjNiNGE0YzE2ZGYyYzNjMzJiOWFmZjYyM2ZlOSIsInRyYW5zYWN0aW9uSWQiOiJjYTc5YWZiMS03YjExLTQ5YjQtODZiYS04NDQ5NThlMDgwZTkifQ%3D%3D

[25] Udtalelse på Tænketanken Europas konference EU, AI og digital suverænitet den 17.november 2023

[27] Ibid.

[28] https://byrnewallace.com/news-and-recent-work/publications/insight-the-european-union-ai-liability-directive.html

[29] https://www.ft.com/content/59b9ef36-771f-4f91-89d1-ef89f4a2ec4e?segmentId=114a04fe-353d-37db-f705-204c9a0a157b

[30] Ibid.

[31] https://www.ft.com/content/f167c499-2399-4b94-8a7b-7a5ccc1bb1cb?desktop=true&segmentId=7c8f09b9-9b61-4fbb-9430-9208a9e233c8#myft:notification:daily-email:content

[32] https://www.euractiv.com/section/artificial-intelligence/news/france-germany-italy-push-for-mandatory-self-regulation-for-foundation-models-in-eus-ai-law/

[34] https://www.goldmansachs.com/intelligence/pages/generative-ai-could-raise-global-gdp-by-7-percent.html refereret fra tale af IMF’s cheføkonom og første vicedirektør, Gina Gopinath - https://www.imf.org/en/News/Articles/2023/06/05/sp060523-fdmd-ai-adamsmith

[35] https://www.mckinsey.com/capabilities/mckinsey-digital/our-insights/the-economic-potential-of-generative-AI-the-next-productivity-frontier#/

[36] https://www.project-syndicate.org/onpoint/an-interview-with-michael-spence-permacrisis-industrial-policy-ai-growth-2023-10?h=OenQX8J2vwmq2%2fraF3nJt1bcurAxALgxeumbIY1NTaY%3d&utm_source=Project+Syndicate+Newsletter&utm_campaign=815a8e74a9-ECON-NEWSLETTER_2023-10_26&utm_medium=email&utm_term=0_-e4393264df-%5BLIST_EMAIL_ID%5D&mc_cid=815a8e74a9&mc_eid=554452bcda

[37] https://services.djoef.dk/r-aa-dgivning/netv-ae-rkogkarriere/ledelse/artikler/2023/professor-ledere-skal-rykke-p-aa--ai-nu.aspx?utm_source=SilverpopMailing&utm_medium=email&utm_campaign=MN_2023_Uge39%20(1)&utm_content=&spMailingID=27302262&spUserID=OTM0OTQ5OTk3NTkS1&spJobID=2312000372&spReportId=MjMxMjAwMDM3MgS2

[38] https://www.ft.com/content/124b4cdb-deb9-49a0-b28d-d97838606661?desktop=true&segmentId=7c8f09b9-9b61-4fbb-9430-9208a9e233c8#myft:notification:daily-email:content

[39] https://www.ft.com/content/124b4cdb-deb9-49a0-b28d-d97838606661?desktop=true&segmentId=7c8f09b9-9b61-4fbb-9430-9208a9e233c8#myft:notification:daily-email:content

[40] https://www.gov.uk/government/publications/ai-safety-summit-2023-the-bletchley-declaration/the-bletchley-declaration-by-countries-attending-the-ai-safety-summit-1-2-november-2023

[41] https://thinkeuropa.dk/notat/2023-01-eus-digitale-suveraenitet-global-leder-eller-overregulering

[43] Tilgået via https://www.ceps.eu/global-ai-governance-is-currently-like-the-tokyo-shibuya-crossing-scrambled/?mc_cid=538bf3543e&mc_eid=43b563c673#:~:text=Global%20AI%20governance%20is%20currently%20like%20the%20Tokyo%20Shibuya%20crossing%20%E2%80%93%20scrambled,-0&text=How%20to%20govern%20Artificial%20Intelligence,Google%20BARD%20and%20Meta's%20LLaMA.

[44] https://digital-strategy.ec.europa.eu/en/policies/european-approach-artificial-intelligence og https://www.consilium.europa.eu/da/press/press-releases/2022/12/06/artificial-intelligence-act-council-calls-for-promoting-safe-ai-that-respects-fundamental-rights/

[45] Ibid.

[46] https://thinkeuropa.dk/debatindlaeg/2023-10-eus-genopretningsfond-ender-med-en-hockeystavsmodel-det-truer-projektets

[47] https://www.whitehouse.gov/briefing-room/presidential-actions/2023/10/30/executive-order-on-the-safe-secure-and-trustworthy-development-and-use-of-artificial-intelligence/

[48] Ibid.

[49] Ibid.

[50] https://www.lexology.com/library/detail.aspx?g=46f5e8c0-eebc-483a-8fed-ca159da8d03e&utm_source=Lexology+Daily+Newsfeed&utm_medium=HTML+email+-+Body+-+General+section&utm_campaign=Lexology+subscriber+daily+feed&utm_content=Lexology+Daily+Newsfeed+2023-11-09&utm_term=

[52] https://www.euractiv.com/section/artificial-intelligence/news/france-germany-italy-push-for-mandatory-self-regulation-for-foundation-models-in-eus-ai-law/

[53] https://www.ft.com/content/647fdf88-d757-45e4-a640-9654673b7ece?segmentId=114a04fe-353d-37db-f705-204c9a0a157b, https://www.weforum.org/agenda/2023/10/generative-ai-resilience-companies/?utm_source=sfmc&utm_medium=email&utm_campaign=2815068_WeeklyAgenda27October2023&utm_term=&emailType=Agenda%20Weekly og https://services.djoef.dk/r-aa-dgivning/netv-ae-rkogkarriere/ledelse/artikler/2023/professor-ledere-skal-rykke-p-aa--ai-nu.aspx?utm_source=SilverpopMailing&utm_medium=email&utm_campaign=MN_2023_Uge39%20(1)&utm_content=&spMailingID=27302262&spUserID=OTM0OTQ5OTk3NTkS1&spJobID=2312000372&spReportId=MjMxMjAwMDM3MgS2

Tænketanken EUROPA indtager ikke holdninger som organisation. Denne tekst repræsenterer alene – som alle udgivelser fra Tænketanken EUROPA – forfatterens/forfatternes betragtninger.